Компания JFrog ML представила результаты опроса специалистов, активно работающих в сфере искусственного интеллекта, включая разработчиков, инженеров машинного обучения, руководителей продуктов и топ-менеджеров. Целью исследования было выявить тенденции, вызовы и перспективы развития ИИ в 2024 году.

Ключевые выводы:

- результаты опроса показали, что 43% ИИ-проектов компаний, представленных в исследовании, находятся на стадии бета-тестирования, 38% — уже внедрены в работу, 19% — на этапе демонстрации или разработки прототипа;

- 78% компаний заявили о том, что уже используют приложения на основе больших языковых моделей (LLM), а 22% планируют их внедрение в ближайшем будущем;

- по данным опроса, 59% организаций выделили на ГенИИ в 2024 году от $10 тыс. до $100 тыс., 18% — более $100 тыс.;

- если 45% компаний увеличили бюджеты на искусственный интеллект на 1–20%, то 23% стали инвестировать на 41–100% больше. Только 1% организаций сократил расходы на ИИ;

- в качестве основных препятствий для внедрения LLM 53% опрошенных назвали трудности с интеграцией во внутренние системы компании, 35% — расходы, 29% — недостаток экспертизы. Опасения вызывает также вопрос безопасности и конфиденциальности данных;

- среди тех, кто работает непосредственно с промптами, 52%, по данным опроса, составляют разработчики, 49% — специалисты по промпт-инжинирингу, 45% — менеджеры по продукту, 36% — специалисты по работе с данными, 27% — аналитики;

- 87% респондентов назвали наиболее часто используемым провайдером ИИ OpenAI, 45% — Google Vertex AI, 37% — AWS Bedrock, 21% — Self-Hosted-модели (самостоятельно размещаемые модели);

- согласно JFrog ML чаще всего большие языковые модели применяются для разработки ПО, управления данными, обслуживания клиентов и анализа текстов;

- наибольшие трудности при интеграции LLM возникают с налаживанием моделей, отслеживанием расходов на них и оценкой качества их работы.

714Дата добавления:16.04.2025

Похожие исследования:

АНО «Цифровая экономика»

АНО «Цифровая экономика»Белая книга цифровой экономики за 2019−2024 годы

Выручка российских ИТ-компаний от реализации товаров и услуг в 2024 году выросла на 27%.Подробнее Strategy Partners

Strategy PartnersУправление данными в промышленных компаниях

Главные барьеры для принятия решений на основе данных — дефицит человеческих ресурсов и компетенций.Подробнее ДИТ Москвы

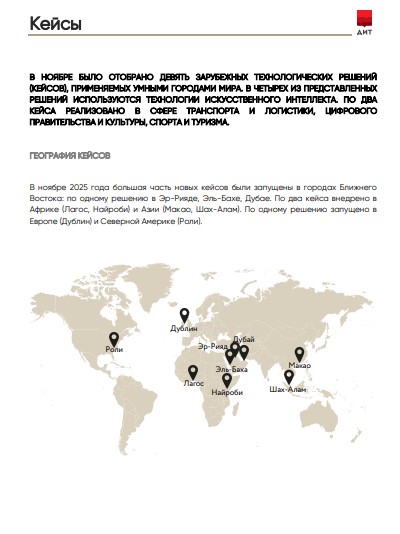

ДИТ МосквыМониторинг международных смарт-практик за ноябрь 2025 года

Аналитики отобрали девять зарубежных кейсов, реализуемых умными городами мира.Подробнее Ростелеком

РостелекомРазвитие умных кампусов

Больше 60% государственных университетов ограничены базовой ИКТ-инфраструктурой.Подробнее

Похожие материалы:

Подпишитесь

на еженедельную подборку исследований от ICT.Moscow

Нажимая на кнопку, вы соглашаетесь с политикой конфиденциальности

Добавить исследование в каталог ICT.Moscow

Что такое ICT.Moscow?

ICT.Moscow — открытая площадка о цифровых технологиях в Москве. Мы создаем наиболее полную картину развития рынка технологий в городе и за его пределами, помогаем бизнесу следить за главными трендами, не упускать возможности и находить новых партнеров.